KI-Validierung im GxP-Umfeld

Warum CSV nicht mehr ausreicht

In der pharmazeutischen Industrie basieren GxP-Prinzipien auf Systemvoraussetzungen, die reproduzierbare „bestanden“ oder „nicht bestanden“ Testergebnisse und statische Systemdefinitionen voraussetzen. Darüber hinaus beruht auch die klassische Computer System Validation (CSV), ein zentraler Baustein regulatorischer Nachweise in der Branche, auf diesen Annahmen. Dieses Rahmenwerk hat in der Vergangenheit gut funktioniert, trotz zahlreicher digitaler und technologischer Innovationen. Mit dem Aufkommen von KI gilt diese Logik jedoch nicht mehr uneingeschränkt.

Der Grund liegt darin, dass KI-Systeme per Definition nicht deterministisch sind. Das bedeutet, dass dieselbe Eingabe mit hoher Wahrscheinlichkeit zu unterschiedlichen Ergebnissen führt, wie es für lernende Systeme typisch ist. Kann CSV mit dieser Dynamik Schritt halten und weiterhin die Sicherheit und Zuverlässigkeit gewährleisten, die in der pharmazeutischen Industrie unverzichtbar sind? Die gute Nachricht ist, dass es möglich ist. Allerdings nur, wenn sich CSV über die bisherigen Schwarz-Weiß-Muster hinaus weiterentwickelt.

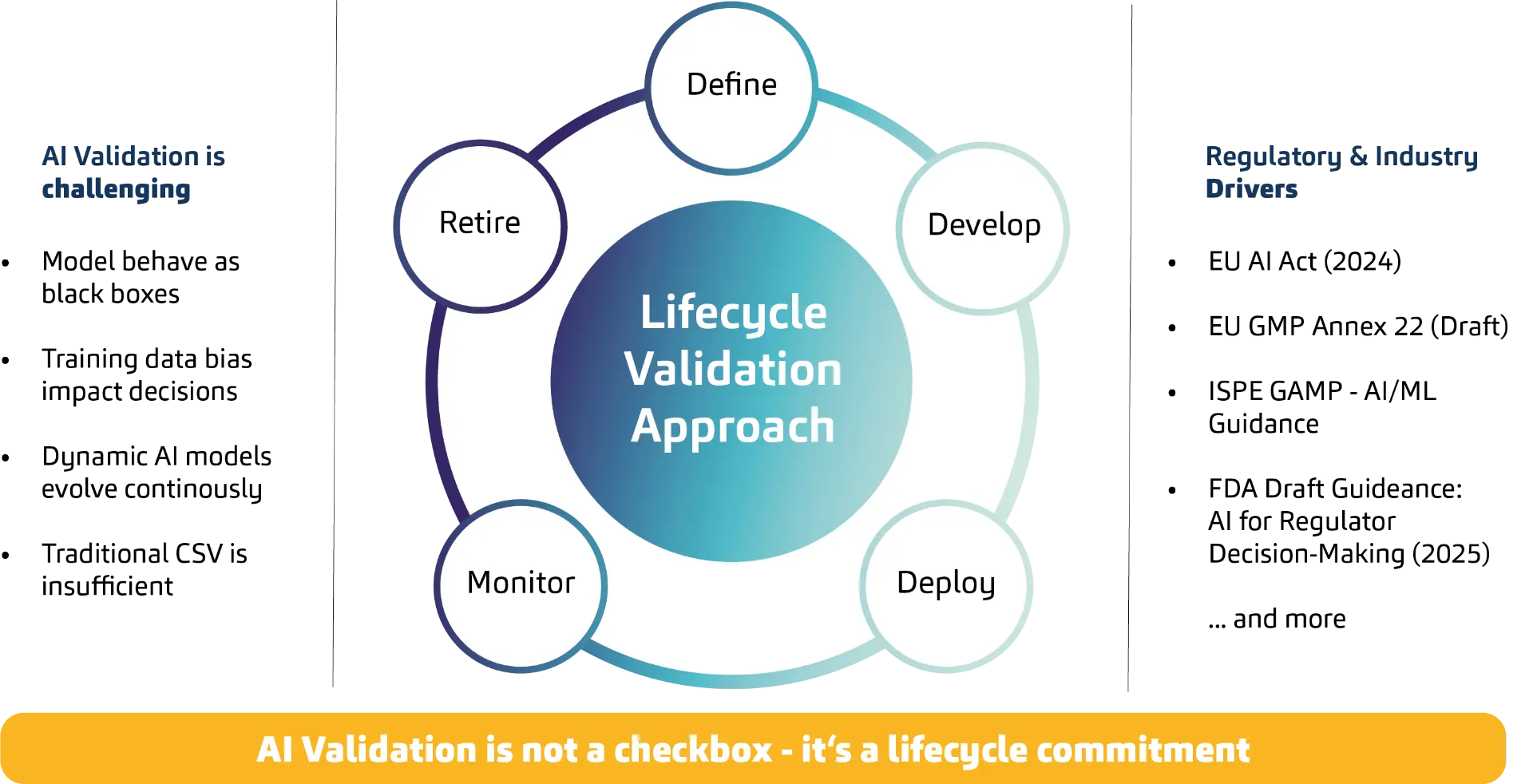

KI-Validierung erfordert einen Lebenszyklusansatz

Im Kern geht es darum, die Perspektive der KI-Validierung von einem punktuellen Ansatz hin zu einer inhärenten Verantwortung über den gesamten Lebenszyklus zu erweitern. Klassische IT-Validierung folgt einem klar definierten Ablauf: Systemzustand festlegen, Anforderungen testen, Abweichungen schließen, freigeben, Release erteilen, fertig. KI durchbricht diese Logik, da Output und Verhalten nicht allein aus einem definierten Systemzustand entstehen, sondern aus einem datengetriebenen Modell und seinem Nutzungskontext. Ergebnisse sind probabilistisch und nicht binär. Da Modelle datengetrieben sind, beeinflussen Retraining, Drift und Veränderungen in den Datenverteilungen über die Zeit hinweg direkt die Ergebnisse.

Die Pharmaindustrie kennt Unsicherheit, aber KI ist anders

Interessanterweise liegt diese grundlegende Veränderung nicht außerhalb des Vorstellungsvermögens der pharmazeutischen Industrie. Im Gegenteil, pharmazeutische Produkte wie Tabletten verhalten sich weitgehend deterministisch, und GxP-Ansätze haben über Jahrzehnte ein nahezu beeindruckendes Maß an Perfektion sichergestellt. Gleichzeitig sind diese Produkte Teil eines pharmakologischen Systems. In diesem interagieren Krankheiten, individuelle Patienten, Umweltbedingungen und pharmazeutische Produkte auf komplexe und vor allem nicht deterministische Weise.

Aus einer anderen Perspektive sind auch Cloud-Systeme für pharmazeutische Hersteller nicht deterministisch, da der Anbieter Änderungen implementiert, ohne dass der Nutzer deren Inhalt und Auswirkungen vollständig kontrollieren kann. Nach einem Update ist das System, unabhängig davon, ob es weiterhin funktioniert oder nicht, ein anderes. Aus Sicht des Softwareanbieters kann es dennoch deterministisch sein, da die Änderungen bekannt sind.

Im Unterschied dazu ist die probabilistische Dynamik von KI eine direkte Folge des Lernens und damit ein grundlegendes Systemprinzip. Dennoch zeigen diese Beispiele, dass vollständig deterministische Systeme eher eine theoretische Vorstellung sind und die Branche bereits in der Lage ist, mit Wahrscheinlichkeiten GxP-konform umzugehen.

Auch der Vergleich mit der Medizintechnik ist aufschlussreich. Dort unterstützt KI bereits heute Entscheidungen mit höchster Relevanz für das Leben von Patienten, beispielsweise bei der Hautkrebs- oder Brustkrebsdiagnostik. Diese Systeme sind streng genommen ebenfalls nicht deterministisch, werden auf großen Datenmengen trainiert und entwickeln sich weiter. Sie müssen ebenfalls validiert werden. Kurz gesagt: CSV kann, muss und wird auch im KI-Zeitalter bestehen bleiben. Wer KI jedoch mit deterministischen Testmustern behandelt, erzeugt entweder eine falsche Sicherheit oder erhöht den Aufwand, ohne die zentralen Risiken zu adressieren.

Was sich bei der Validierung von KI verändert

KI bringt Themen mit sich, die der klassischen CSV bislang fremd sind und nun in den Fokus rücken. Zur Veranschaulichung lassen sich einige zentrale Aspekte hervorheben. Qualität ergibt sich nicht mehr allein aus dem Systemzustand, sondern aus Modell, Daten und Verhalten über die Zeit hinweg. Systeme verhalten sich dadurch wie Black Boxes. Dies erfordert einen starken Fokus auf Erklärbarkeit sowie robuste Human-in-the-loop-Mechanismen. Ein weiterer Aspekt ist Bias. Verzerrungen in den Trainingsdaten können Ergebnisse beeinflussen und müssen daher als Qualitäts- und Risikothema behandelt werden. Hinzu kommen zeitliche Veränderungen wie Retraining, Drift und Anpassungen in Datenpipelines, die das Modellverhalten beeinflussen. Das kann positiv sein, jedoch nur, wenn die Entwicklung in die richtige Richtung verläuft und kontrolliert bleibt.

Das bereits beim Cloud-Beispiel sichtbare Problem zeigt sich auch hier. Steuerbarkeit und Nachweisbarkeit entstehen durch Governance, Monitoring und kontrollierte Änderungen. In dynamischen, probabilistischen Systemen gelingt dies nur, wenn Validierung künftig als eine Form der Echtzeitvalidierung verstanden wird, also als Zusammenführung von Testen und Monitoring. Ebenso muss sich die klassische Pass/Fail-Logik hin zu statistischer Absicherung und Szenarienabdeckung weiterentwickeln, und Systemvalidierung wird zur Validierung eines Ökosystems aus Daten, Modell und Nutzungskontext. Letztlich bedeutet der Einsatz von KI im GxP-Umfeld, Verantwortung für den gesamten Lebenszyklus des Systems zu übernehmen und kontinuierliche Veränderungen mitzudenken.

Ein praktischer, lebenszyklusbasierter Validierungsansatz

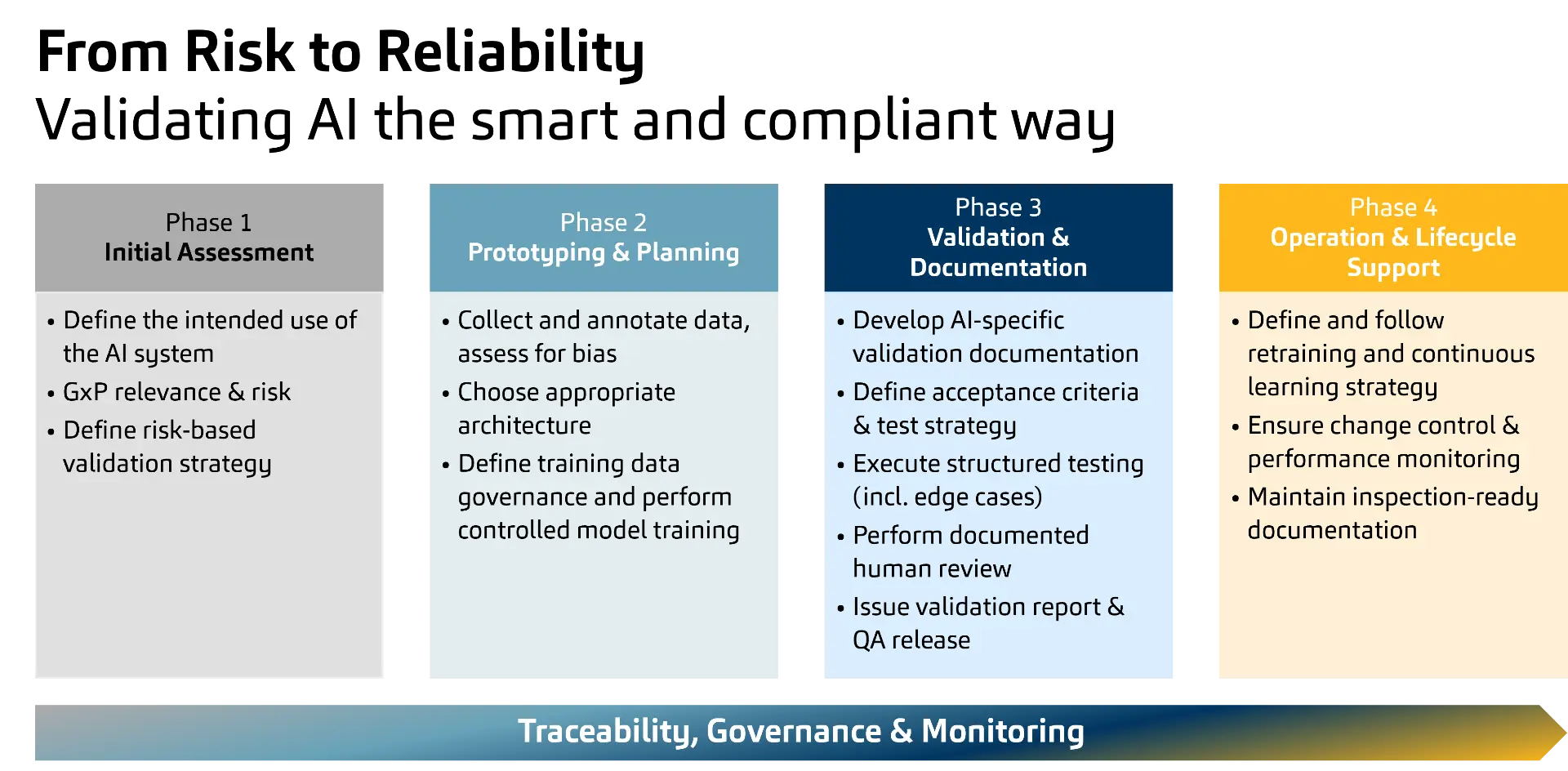

Vor diesem Hintergrund stellt sich die konkrete Frage, welche KI-Anwendungsfälle im GxP-Umfeld sinnvoll sind und wie ein Validierungs- und Betriebsrahmen gestaltet werden kann, der auditierbar bleibt und gleichzeitig die Dynamik von KI kontrolliert. Praktisch lässt sich dies in vier Schritte strukturieren, die zu einem zukunftsfähigen, lebenszyklusorientierten Validierungsansatz führen.

Vier-Phasen-KI-Ansatz

Regulatoren bewegen sich in Richtung Lebenszyklusansatz

Dass es sich hierbei nicht um eine rein theoretische Diskussion handelt, zeigt ein Blick auf die wichtigsten regulatorischen Entwicklungen der letzten Jahre. Der EU AI Act definiert ein KI-System als ein maschinenbasiertes System, das mit unterschiedlichen Graden an Autonomie betrieben wird, nach der Inbetriebnahme Anpassungsfähigkeit zeigen kann und aus Eingaben ableitet, wie es Ergebnisse wie Vorhersagen, Inhalte, Empfehlungen oder Entscheidungen erzeugt. Parallel dazu betonen Leitlinien den Lebenszyklusansatz, darunter der EU GMP Annex 22 im Entwurf, die ISPE GAMP AI/ML Guidance sowie aktuelle Diskussionen der FDA. Bereits 2019 stellte die FDA in ihrem Vorschlag zu Änderungen bei KI- und ML-basierten Softwarelösungen als Medizinprodukt fest, dass klassische Zulassungslogiken von statischen Systemen ausgehen, während KI- und ML-Systeme adaptiv sein können. Darauf aufbauend betonen FDA, Health Canada und MHRA in den Good Machine Learning Practices von 2021, dass Modelle über ihren gesamten Lebenszyklus hinweg überwacht und Änderungen kontrolliert sowie dokumentiert werden müssen.

Der Weg nach vorn

Vor diesem Hintergrund ist die Auseinandersetzung mit den Veränderungen, die KI für die Validierungspraxis mit sich bringt, keine theoretische Übung. Sie ist sowohl geschäftlich als auch regulatorisch zwingend erforderlich. Das Risiko liegt nicht im Einsatz von KI selbst, sondern im Einsatz ohne einen Validierungsansatz, der nicht deterministisches Verhalten, Lebenszyklusveränderungen und Datenabhängigkeit als Kern der Qualitätssicherung versteht.

Autoren

Sie möchten mehr über dieses Thema erfahren oder individuelle Herausforderungen diskutieren?

Unsere Ansprechpartner stehen Ihnen gerne für ein persönliches Gespräch zur Verfügung.